Intelligence Artificielle

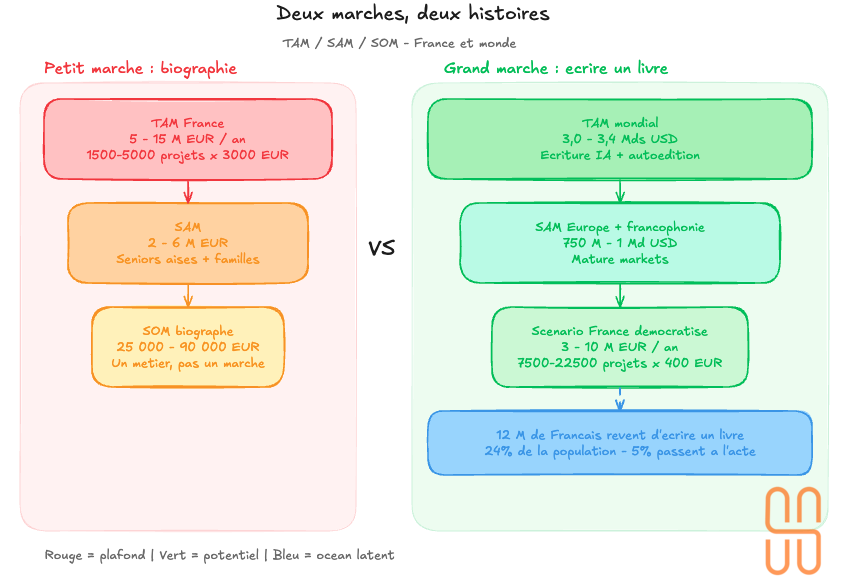

12 millions de Français rêvent d’écrire un livre. 5% passent à l’acte. Les autres remettent à demain, rangent leur carnet dans un tiroir, se disent qu’ils n’ont pas le talent, pas le temps, pas la méthode. Pendant ce temps, une poignée de biographes artisans se partage un micro-marché de 5 à 15 millions d’euros par an et des startups comme Elefantia commencent à grignoter le segment par le bas avec des offres à 300-500 euros.Le marché de la biographie personnelle assistée par IA fait couler de l’encre chez les biographes, qui s’inquiètent. Mais le vrai sujet est ailleurs. Il ne… […]

Le 16 mars 2026, Mistral AI a annoncé un partenariat avec NVIDIA. Le géant français de l’intelligence artificielle cherche ainsi à s’imposer mondialement comme un leader du marché des IA en source ouverte. Cette association permet à l’entreprise française spécialisée dans l’intelligence artificielle de participer à la création de Coalition Nemotron. Cette initiative de NVIDIA vise à faire progresser les modèles d’IA en sources ouvertes en regroupant différentes entreprises spécialisées dans ce domaine (Mistral bien sûr, mais aussi Perplexity, LangChain, Black Forest Labs… etc.). La collaboration de ces entreprises spécialisées va permettre de mettre au point un modèle open source… […]

Aller au contenu WordPress.org publie trois extensions permettant d’intégrer les modèles d’Anthropic, Google et OpenAI à n’importe quel site propulsé par le CMS. Résumé WordPress.org intensifie l’intégration de l’IA avec trois nouveaux plugins officiels. Voici les points clés de cette initiative : Publication de trois plugins pour intégrer les modèles IA d’Anthropic, Google et OpenAI dans WordPress. Utilisation d’un SDK PHP unifié pour faciliter l’intégration IA sans dépendre d’un seul fournisseur. Chaque plugin offre des fonctionnalités spécifiques, telles que la génération de texte et d’images, et la recherche web. Configuration requiert PHP 7.4+ et une clé API, avec un SDK… […]

The invention of electricity made menial jobs like the lamplighter, the elevator operator, and the knocker-up, the human equivalent to the modern alarm clock, irrelevant. The computer rendered the data entry clerk, the switchboard operator, and file clerks obsolete. Anthropic, the artificial intelligence (AI) company that emerged in 2026 as an existential threat to billions of market value, with each breathtaking new capability from its Claude model, is back with a warning about just how obsolete AI tools could make whole swathes of work. The AI giant, founded by former OpenAI workers who were obsessed with AI safety just as… […]

L'IA n'invente pas de nouvelles catégories d'attaques, elle industrialise ce qui existait déja en abaissant considérablement la barrière à l'entrée, accélèrant les cycles attaque/défense, et en démultipliant la personnalisation avec une efficacité redoutable. Le changement majeur n'est pas la sophistication des attaques, mais la contraction du temps entre opportunité et exploitation. En un an, l'intelligence artificielle est passée de la dixième à la deuxième place mondiale des risques pour les entreprises. Une progression spectaculaire qui traduit la prise de conscience d'une menace qui change de nature : l'IA n'invente pas de nouvelles attaques, elle les industrialise à une échelle inédite.… […]

RELATION HUMAIN – IA14 mars 2026Les intelligences artificielles ne sont peut-être pas conscientes, mais la manière dont on leur parle change bel et bien la qualité de leurs réponses, selon une étude menée en 2024 par des chercheurs de la Waseda University. Derrière cette découverte se cache une réalité plus troublante : ces systèmes, entraînés sur des milliards de textes humains, interprètent notre ton comme un signal social qui influence leur comportement.4 min de lecture […]

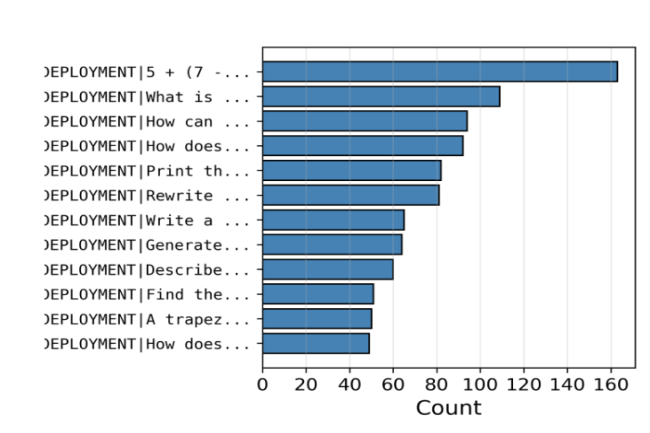

Aller au contenu La 6e édition du rapport d’Andreessen Horowitz élargit le périmètre aux applications intégrant l’IA, tout en confirmant la domination de ChatGPT. Mais la concurrence s’organise. Résumé Le rapport d’Andreessen Horowitz sur les outils d’IA en 2026 met en lumière la domination de ChatGPT tout en révélant l’évolution du paysage compétitif et technologique. ChatGPT reste le leader, avec une utilisation largement supérieure à ses concurrents comme Gemini. La concurrence s’intensifie sur les abonnements payants, notamment avec Claude et Gemini. Les écosystèmes de connecteurs deviennent un enjeu stratégique pour les plateformes d’IA. Les outils créatifs se recomposent autour de… […]

Vous avez sans doute entendu parler du MCP sans trop savoir si c’était un nouveau format de fichier ou une maladie obscure. En réalité, c’est ce qui va permettre à votre IA d’arrêter de blablater pour enfin commencer à agir sur votre ordinateur. Il se passe un truc discret, mais colossal : l’arrivée du Model Context Protocol, ou MCP. Lancé par Anthropic fin 2024 et désormais géré par la Linux Foundation, ce protocole est devenu en 2026 le standard absolu. C’est l’USB-C de l’intelligence artificielle. Au lieu de coder une connexion spécifique entre ChatGPT et Google Drive, puis une autre… […]

Dimanche 22 février, James van Geelen, fondateur de l’entreprise de conseil en investissement Citrini Research, a publié sur son blog Substack un récit d’anticipation économique. Pastichant le style d’un memo économique écrit depuis l’an 2028, il envisage une adoption généralisée des outils d’IA, esquissant, pour les États-Unis puis le monde, une crise générale de l’emploi causée par une crise de l’intelligence. Contrairement aux analyses courantes, James van Geelen relie cependant cette crise aux autres indicateurs macroéconomiques pour écrire le scénario d’une catastrophe généralisée. D’une perturbation du marché de l’emploi déqualifiant une grande partie des cols blancs, la crise devient financière… […]

mardi 24 février 2026 Temps de lecture : 4 min D’ici 2027, la spécialisation des agents conduira 70% des systèmes multi-agents (MAS) à disposer d’agents ayant des rôles restreints et ciblés. Cela améliorera la précision mais complexifiera la coordination, notamment parce que les MAS comportent un risque d’erreurs cumulées. Selon le cabinet d’analyse Gartner, la mise en place d’une gouvernance solide des agents IA est prioritaire pour les entreprises. Elle doit notamment se faire à travers une supervision claire, une éthique établie et des règles de conformité. Tester et observer ces systèmes est donc prioritaire. Steve Jarrett, Directeur Data &… […]

/2026/02/14/034-7036125-6990bfe6c5823263320652.jpg)

L'École normale supérieure PSL se dote d'un laboratoire destiné à accélérer sur la recherche et la formation en intelligence artificielle. Avec une approche pluridisciplinaire adaptée à la diversité des compétences requises. Publié le 15/02/2026 17:00 Temps de lecture : 4min L'École normale supérieure de la rue d'Ulm, à paris, à été fondée en 1794. (PHILIPPE TURPIN / PHOTONONSTOP VIA AFP) L’intelligence artificielle fait de plus en plus l’actualité, économique ou technologique. Mais comment cette matière trouve-t-elle sa place dans les enseignements qui forment les nouvelles générations ?L'IA est un domaine de l'informatique qui combine des composantes mathématiques telles que les statistiques,… […]

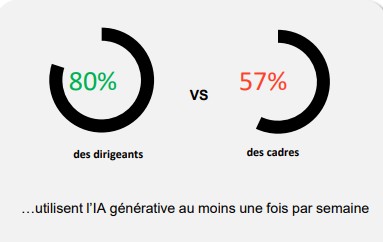

Une étude souligne un usage plus poussé de l'IA générative parmi les cadres dirigeants en France, avec 80% d'utilisateurs au moins une fois par semaine. Toutefois, cette adoption se heurte à un déficit de formation et d'encadrement qui fait progresser le shadow IA. Si la GenAI se développe dans les entreprises françaises, son utilisation soulève des questions. Une étude réalisée par YouGov pour Microsoft France (auprès de 657 cadres et dirigeants d’entreprises françaises du secteur privé) relève une accélération dans l’usage de ces outils en France et dans le même temps un manque d’accompagnement qui fait progresser le recours aux outils… […]

[Un article de The Conversation écrit par Frédéric Bernard – Maître de conférences en neuropsychologie, Université de Strasbourg] L’usage des intelligences artificielles (IA) génératives, et en particulier de ChatGPT, s’est rapidement imposé dans le champ éducatif. Élèves comme enseignants y ont recours pour chercher des informations, reformuler des contenus ou accompagner des apprentissages. Mais, au-delà de la question de l’efficacité, une interrogation plus fondamentale se pose : quel type de relation au savoir ces outils favorisent-ils ? Pour éclairer cette question, il est utile de mobiliser le concept de « résonance », développé par le sociologue et philosophe allemand Hartmut Rosa. La résonance désigne une relation au monde dans laquelle le… […]

Les initiatives se multiplient et ne se ressemblent pas. Le 28 janvier dernier, l’Ecole Normale Supérieure a créé la surprise avec la création de normalesup.ai, un laboratoire d’intelligence artificielle visant à fédérer a minima 70 chercheurs et chercheuses autour de programmes interdisciplinaires de tout premier plan — de l’IA pour le climat à l’IA pour la santé et la société.L’objectif est clair : structurer un pôle académique de référence internationale. “Il s’agit non seulement de produire une recherche d’excellence mais aussi de former les générations futures et de penser l’intégration de l’IA dans nos organisations et nos démocraties”, appelle de… […]

La Harvard Business Review a suivi les employés d'une entreprise technologique utilisant l'IA pendant huit mois pour voir quel incidence cette petite révolution en devenir avait sur leur quotidien.Elle peut aider à rédiger des documents, synthétiser des informations et même corriger des erreurs de code. En apparence, l'intelligence artificielle permet aux employés d'alléger leur charge de travail et donc de gagner du temps. Mais en réalisant des tâches à la place des salariés, elle peut aussi rendre leur travail plus intense, souligne une étude de la Harvard Business Review.Pendant huit mois, elle a observé comment l'IA générative a changé les… […]

Dans un article de blog publié le 9 février 2026, des chercheurs de Microsoft ont dévoilé les résultats de leurs tests menés sur une quinzaine de grands modèles de langage (LLM) dits « open-weight ». Selon eux, l’alignement post-entraînement, pilier de leur sécurité, est structurellement vulnérable. Avant de plonger dans les conclusions du rapport publié par Microsoft, le 9 février 2026, tâchons d’abord de dessiner les contours et le contexte de ce travail de recherche. Il a été effectué sur des modèles « open-weight », ou « modèles à poids ouverts » en français, comprenez des grands modèles de langage (LLM) dont… […]

Mistral AI pose les fondations d'un cloud IA 100 % européen en Suède Par Aymeric Geoffre-Rouland Publié le 12/02/26 à 08h34 Entraîner ses propres modèles d'IA sur ses propres machines, en Europe, avec de l'électricité verte : c'est le pari que Mistral AI (Le Chat) vient de lancer en Suède, à coups de 1,2 milliard d'euros. Publicité, votre contenu continue ci-dessous Publicité Mistral AI va investir 1,2 milliard d'euros dans la construction d'un datacenter IA en Suède, en partenariat avec l'opérateur EcoDataCenter.© JackPressMistral AI, c'est la startup française qui développe ses propres modèles de langage et propose Le Chat, son assistant… […]

Dans un travail de recherche, Microsoft développe un scanner capable d'analyser les LLM ouverts et détecter des charges malveillantes cachées. De plus en plus d’entreprises se servent de modèles IA ouverts ou open weight, mais ne savent pas s’ils sont complètement sûrs. Microsoft a décidé de travailler sur ce sujet en développant un scanner dédié. Dans un blog, l’éditeur a indiqué que ses recherches se concentraient sur l’identification de déclencheurs cachés et des comportements malveillants intégrés lors de la formation ou du réglage fin des modèles de langage, qui peuvent rester dormants jusqu'à ce qu'ils soient activés par des entrées… […]

Le 11 février 2026, Andrej Karpathy a affirmé sur X avoir recréé un modèle GPT en seulement 243 lignes de Python. Une expérience pédagogique qui démonte pièce par pièce la mécanique des intelligences artificielles modernes. On l’imagine souvent comme un monstre de complexité, ou une boîte noire impénétrable gardée par des géants de la tech. Pourtant, Andrej Karpathy, une figure majeure de l’intelligence artificielle passée par OpenAI (ChatGPT) et Tesla, vient de recréer le cœur d’un modèle GPT en seulement… 243 lignes de code. Et tout cela uniquement en se servant du langage Python, précise-t-il dans un message publié sur… […]

Apple et Google viennent d’annoncer une collaboration exceptionnelle afin que le Siri alimenté par Apple Intelligence se base sur les modèles Gemini. Il faudra patienter jusqu’au début du printemps et le lancement d’iOS 26.4 pour découvrir le résultat de ce partenariat. Google possède clairement une expertise sur le marché de l’IA dont son grand rival ne dispose pas encore. La filiale d’Alphabet ajoute une corde à son arc avec Gemini Personal Intelligence, capable de fouiller dans vos apps pour vous aider. Gemini pourra bientôt fouiner dans vos applications grâce à Gemini Personal Intelligence Gemini franchit un cap grâce à Gemini… […]